Η λεγόμενη τεχνητή νοημοσύνη είναι ένα αμφιλεγόμενο θέμα για διάφορους λόγους, όπως ο χειρισμός των πνευματικών δικαιωμάτων, η χρήση ενέργειας, οι ανησυχίες σχετικά με το απόρρητο και τα chatbots όπως το ChatGPT που μερικές φορές δίνουν λανθασμένες απαντήσεις.

Ωστόσο, υπάρχει ένα πράγμα στο οποίο μπορούν να συμφωνήσουν οι κριτικοί και οι ευαγγελιστές: η τεχνητή νοημοσύνη διαπερνά όλο και περισσότερο πολλά στρώματα της ψηφιακής ζωής, από τον πολιτισμό στην επιχείρηση στην πολιτική. Όπως συμβαίνει συνήθως με τις νέες τεχνολογίες, η αύξηση της παράνομης χρήσης της τεχνητής νοημοσύνης με τη μορφή deepfakes συνδέεται βαθιά με την αύξηση της δημοτικότητάς της και, το πιο σημαντικό, της προσβασιμότητας. Τα Deepfakes είναι βίντεο ή μορφές ήχου που δημιουργούνται από τεχνητή νοημοσύνη και υποδύονται, για παράδειγμα, διασημότητες ή πολιτικούς για να διαδώσουν λανθασμένα ή παραπληροφόρηση ή εξαπάτηση των καταναλωτών. Οι επιχειρήσεις σε όλο τον κόσμο μπορούν ήδη να νιώσουν τον αντίκτυπο αυτού του τύπου τεχνητού περιεχομένου.

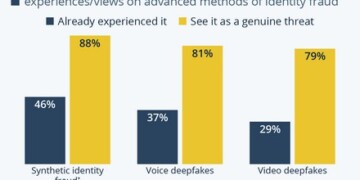

Μια έρευνα από τον πάροχο επαλήθευσης ταυτότητας Regula που διενεργήθηκε σε περισσότερους από 1.000 ειδικούς στον εντοπισμό ή την πρόληψη απάτης από χώρες όπως οι Ηνωμένες Πολιτείες, το Ηνωμένο Βασίλειο, η Γαλλία και η Γερμανία δείχνουν ότι ένα μεγάλο μέρος των εταιριών τους στοχοποιήθηκαν από μία από τις τρεις μεθόδους προηγμένης απάτης ταυτότητας.

Το 46% των ερωτηθέντων αντιμετώπισαν περιπτώσεις απάτης συνθετικής ταυτότητας, όπου χρησιμοποιήθηκε ένας συνδυασμός πραγματικών και πλαστών στοιχείων ταυτότητας, όπως ένας πλαστός αριθμός κοινωνικής ασφάλισης και ένα πραγματικό όνομα, διεύθυνση και ημερομηνία γέννησης.

Το 37% ανέφερε ότι είδε να χρησιμοποιούνται ψεύτικα ψεύτικα φωνής, ένα πρόσφατο παράδειγμα υψηλού προφίλ του οποίου από τη σφαίρα της πολιτικής ήταν ένας τεχνητός πρόεδρος Μπάιντεν που κάλεσε τους υποψήφιους ψηφοφόρους τον Ιανουάριο για να τους αποτρέψει να ψηφίσουν στις προκριματικές εκλογές.

Τα deep fake βίντεο είναι, προς το παρόν, λιγότερο συνηθισμένα, με μόνο το 29% των ερωτηθέντων να έχουν ήδη βιώσει τέτοιες απόπειρες απάτης. Με τις εταιρίες παραγωγής τεχνητής νοημοσύνης να επικεντρώνονται πλέον στις κινούμενες εικόνες, με εργαλεία όπως το Sora του OpenAI, αυτό το πρόβλημα θα μπορούσε να γίνει πιο έντονο τους επόμενους μήνες και χρόνια.

Αυτή η ανησυχία αντικατοπτρίζεται επίσης στο ποσοστό των εμπειρογνωμόνων που ερωτήθηκαν που πιστεύουν ότι αυτές οι τρεις μέθοδοι απάτης θα γίνουν πραγματική απειλή, με ποσοστό μεταξύ 80 και 90% να συμφωνεί με αυτήν την αξιολόγηση.

«Οι ψεύτικες ταυτότητες που δημιουργούνται από την τεχνητή νοημοσύνη μπορεί να είναι δύσκολο να εντοπιστούν από τους ανθρώπους, εκτός εάν είναι ειδικά εκπαιδευμένοι για να το κάνουν», λέει ο Ihar Kliashchou, Chief Technology Officer στη Regula. «Ενώ τα νευρωνικά δίκτυα μπορεί να είναι χρήσιμα για την ανίχνευση deep fakes, θα πρέπει να χρησιμοποιούνται σε συνδυασμό με άλλα μέτρα κατά της απάτης που εστιάζουν σε φυσικές και δυναμικές παραμέτρους».

You will find more infographics at Statista

You will find more infographics at Statista